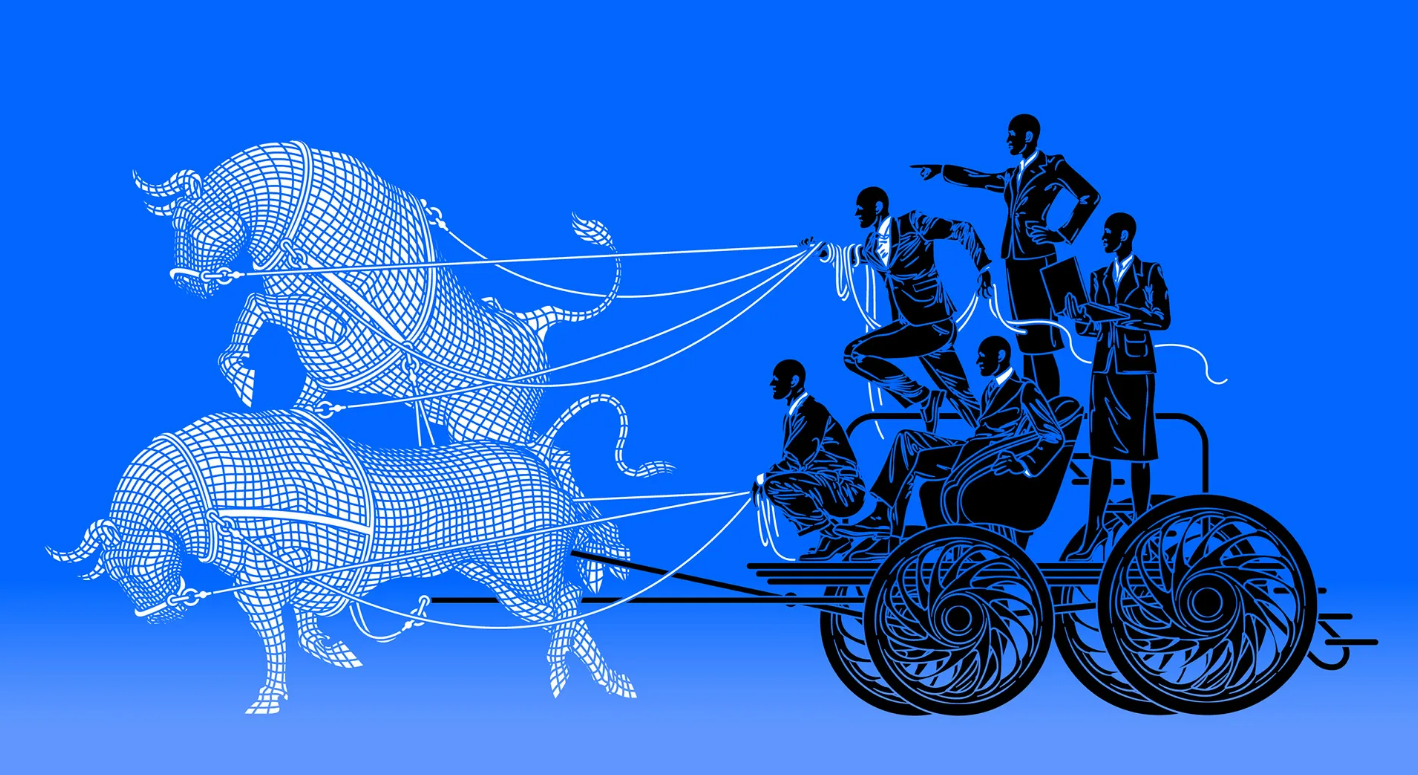

Intelligenza Artificiale, automazione e concentrazione di potere

Negli ultimi due anni l’intelligenza artificiale (IA) è diventata a pieno titolo una tecnologia pervasiva. Molti esperti e appassionati ritengono – giustamente – che il suo avvento possa rivelarsi una delle più grandi rivoluzioni della storia. I più ottimisti pensano che questa nuova tecnologia possa migliorare nettamente la qualità della vita con applicazioni benefiche in qualsiasi campo, dalla medicina alle scienze dei materiali; dall’educazione alla finanza e persino al governo. Alcuni, come l’ex CEO di Google Eric Schmidt e l’ex segretario di stato americano Henry Kissinger, si sono addirittura spinti ad affermare che attraverso di essa potremmo avere una chance di avvicinarci a una nuova forma gnostica di comprensione della realtà.[1]

Se di certo i vantaggi prospettati non mancano, occorre però ricordare che storicamente nessuna delle grandi rivoluzioni è andata esattamente come previsto, e che anzi sono quasi tutte state accompagnate da anni o decenni di scompiglio: basti pensare all’inasprirsi delle condizioni di vita e lavoro nell’Inghilterra della prima Rivoluzione Industriale, o al regime del terrore che seguì alla Rivoluzione francese. E difatti, anche su questo fronte le elucubrazioni riguardo all’intelligenza artificiale non mancano: se già da tempo si discute del vertiginoso aumento di disinformazione dovuto alla proliferazione di contenuti generati da bot, o dei potenziali pericoli legati ad applicazioni come il riconoscimento facciale, i più pessimisti temono addirittura che l’intelligenza artificiale possa sfuggirci di mano, e che l’emergere di una “super-intelligenza” possa rappresentare un rischio esistenziale per il futuro dell’umanità.

Automazione di tipo nuovo

Tuttavia, se si desidera abbandonare il mondo delle mere speculazioni e comprendere in modo più approfondito cosa significa l’entrata sul mercato di questa tecnologia, e quali impatti concreti potrebbe avere sull’economia, la società, e le nostre vite future, è necessario fare un passo indietro, e cercare di comprendere da dove è emersa e cosa rappresenta di fatto al momento attuale.

Al suo nocciolo, e per design, l’intelligenza artificiale è fondamentalmente un nuovo tipo di automazione, che potremmo classificare in quattro grandi categorie:

- L’automazione dell’estrazione di “conoscenza”

- L’automazione di meccanismi di controllo dell’attenzione

- L’automazione della generazione di contenuti

- L’automazione del lavoro mentale.

Nel seguito di questo articolo cercheremo di analizzare più in dettaglio ciascuna di esse, descrivendo il contesto in cui sono nate le tecnologie che vi stanno alla base, e quali sono le forze economiche in gioco che ne stanno spingendo ulteriormente lo sviluppo. La comprensione del contesto storico ed economico in cui sono avvenuti e stanno procedendo questi sviluppi è fondamentale per capire quali sono i grandi player che stanno traendo maggior vantaggio da questa rivoluzione, e come plausibilmente cercheranno di continuare a guidarla. In particolare, quest’analisi ci permetterà di comprendere non solo la direzione generale che sta assumendo questo grande cambiamento tecnologico, ma anche quali sono i rischi reali e concreti a cui dovremmo dedicare le nostre attenzioni, fra cui in primis l’esacerbarsi di una già pericolosa spirale di concentrazione esponenziale del potere.

Il primo di tipo di automazione, l’estrazione di conoscenza, ha avuto origine quando le prime piattaforme digitali, come Google e Facebook, si sono rese conto degli enormi profitti che potevano ottenere tramite l’applicazione dei cosiddetti metodi di “machine learning” per estrarre conoscenza dalle immense quantità di dati grezzi generati involontariamente dagli utenti durante l’utilizzo dei loro servizi. È in questo contesto, dall’unione di big data con quella che potrebbe essere chiamata big compute – la disponibilità di grandissime capacità di calcolo all’interno dei primi grandi data center – che nella prima e seconda decade del 2000 son state gettate le basi per lo sviluppo dei primi modelli di intelligenza artificiale moderni, inizialmente disegnati per trasformare i dati comportamentali in conoscenza, ovvero modelli statistici degli utenti che a loro volta possono essere impiegati per regolarne e controllarne il comportamento futuro, e generare dunque profitti più elevati.

Da allora su questo fronte son stati compiuti progressi enormi, e se inizialmente l’applicazione dell’intelligenza artificiale era limitata all’analisi dei siti visitati o dei like rilasciati da un utente, oggi compagnie come Meta e TikTok possono avvalersi di algoritmi in grado di comprendere in modo approfondito anche il contenuto delle immagini e dei video che l’utente guarda sulle proprie piattaforme (o dei commenti che scrive). Al contempo son stati costruiti modelli sempre più sofisticati, addestrati ventiquattro ore su ventiquattro per dedurre il massimo grado di conoscenza dalle ingenti quantità di dati a loro disposizione.

Questa breve analisi ci conduce direttamente al secondo tipo di automazione, il controllo dell’attenzione. Col loro arrivo sul mercato, i social media hanno rapidamente imparato a indirizzare algoritmicamente l’attenzione dei propri utenti attraverso una moltitudine di nuove tecniche, che vanno dal montaggio statistico utilizzato per assemblare un news feed accattivante, ai sistemi di raccomandazione che cercano di prevedere ciò che essi potrebbero voler acquistare, leggere o guardare. Alcuni di questi sistemi sono ora tra le reti neurali più complesse in fase di continuo addestramento.

Man mano che i sistemi per guidare l’attenzione degli utenti vengono perfezionati, le grandi piattaforme stanno ora investendo enormi capitali nello sviluppo di strumenti migliori per la generazione di contenuti. I cosiddetti ‘foundation models’, modelli generativi capaci di sintetizzare testi, musiche, immagini e video simili a quelli che potrebbero essere prodotti da un essere umano, rientrano in questa categoria. Abilitando la generazione automatica di contenuti, le piattaforme acquisiranno la capacità di creare ‒ o di consentire ai propri utenti di creare ‒ pool di informazioni ancora più vasti, che potranno poi essere utilizzati per chiudere il cerchio e vincolare sempre di più l’attenzione degli utenti alla piattaforma stessa.

Infine, proprio come il motore a vapore ha dato il via alla Rivoluzione Industriale e all’automazione del lavoro manuale, l’IA sta ora alimentando una grande corsa verso l’automazione di tutto il lavoro mentale. Fornendo strumenti flessibili che possono essere utilizzati in modo trasversale per automatizzare ogni tipo di lavoro, dalla redazione di notizie alla consulenza, dal design d’interni alla produzione musicale, dal doppiaggio all’illustrazione, i grandi fornitori di sistemi di intelligenza artificiale hanno il potenziale per trasformare tutti questi settori in enormi mercati verticali.

Come effetto collaterale, il ruolo del lavoro umano nel mercato del lavoro potrebbe essere radicalmente ridefinito. Con l’avvento delle auto a guida autonoma, i conducenti di taxi e camion sono stati a lungo considerati tra i primi nella lunga lista di coloro che potrebbero dover temere per i propri posti di lavoro. Tuttavia, il recente avvento delle IA generative ha mostrato che non solo la lista indubbiamente non si ferma qui, ma potrebbe addirittura iniziare in luoghi completamente inaspettati. È stato riportato che GPT-4 ha ottenuto un punteggio superiore a quello del 90% degli avvocati americani nell’esame di ammissione alla professione legale, e un sistema di OpenAI chiamato Harvey è già utilizzato da svariati studi legali per automatizzare la generazione di documenti di ogni tipo. Nell’ultimo decennio, strumenti simili sono stati impiegati su larga scala nei dipartimenti di risorse umane per filtrare la maggior parte delle candidature, o nel giornalismo per generare una quota sempre più ampia della copertura di notizie finanziarie e sportive. Sebbene spesso si sostenga che l’uso di questi strumenti richieda comunque la supervisione umana, l’enorme aumento della produzione che consentono diminuirà inevitabilmente la domanda di lavoratori. Una settimana di lavoro di un team di artisti digitali esperti può ora essere svolta in pochi minuti da un singolo individuo privo di qualificazioni.

Nel cosiddetto ‘metaverso’, gli ‘umani digitali’ avranno senz’altro applicazioni divertenti come avatar, ma non è difficile immaginare come nel mondo reale saranno presto in grado di prendere il lavoro di decine di milioni di persone. E se i primi lavori a rischio saranno quelli poco gratificanti degli operatori di call center, i prossimi potrebbero essere i ben più delicati ruoli degli insegnanti dei vostri figli,[2] o quelli dei giornalisti del vostro quotidiano preferito.

IA, sostituto o complemento degli umani?

Ovviamente, si potrebbe pensare che in generale un aumento dell’automazione non sia necessariamente negativo: se determinati lavori possono essere eseguiti da macchine, gli esseri umani potrebbero essere liberati per utilizzare il loro tempo per compiti più complessi e interessanti. Questa è una posizione abbracciata da molti imprenditori e tecnologhi che sostengono che, come nei secoli passati, la tecnologia non distruggerà più posti di lavoro di quanti ne creerà. I sostenitori di questa posizione fanno notare che storicamente le nuove tecnologie hanno costantemente reso obsolete dozzine di lavori, e ciononostante, alimentando la crescita e ampliando il mercato, hanno sempre compensato abbondantemente creando tipologie di lavoro interamente nuove ‒ e rendendo la società complessivamente più ricca. Inoltre, suggeriscono che invece di essere pensata come un sostituto degli esseri umani, l’IA sia meglio vista come un loro complemento, che ne aumenta la produttività assumendosi i compiti più ripetitivi, come nel caso dei chirurghi liberati dall’analisi di scansioni mediche e dalla lettura di lunghe liste di cartelle cliniche dei pazienti.

Leggi anche: Un marketing intelligente

Tuttavia, economisti influenti stanno iniziando a mettere in dubbio questa visione ottimistica. Tra questi, Daniel Susskind ha recentemente notato come molte delle tendenze e delle forze che storicamente hanno aiutato il mercato del lavoro ad adattarsi all’obsolescenza e alla dislocazione tecnologica dei posti di lavoro potrebbero ora essere giunte a fine corsa. In particolare, l’idea che ci sarà sempre lavoro per tutti si basa sull’assunzione che ci saranno sempre compiti che gli esseri umani possono eseguire meglio o a un costo inferiore rispetto alle macchine. Tuttavia, nell’era dell’IA, questo assunto potrebbe non essere più valido. I grandi modelli linguistici stanno già dimostrando come l’intelligenza artificiale sia ora in grado di automatizzare anche compiti che sono sempre stati considerati impossibili per una macchina, come scrivere un pezzo per un quotidiano, generare un codice informatico, riassumere un libro o intrattenere una conversazione. Le intelligenze artificiali generative possono ora eseguire in una frazione di secondo il lavoro che a un illustratore o a un musicista esperto richiederebbe giorni o settimane intere, compiti che sono sempre stati considerati il segno distintivo della creatività umana e certamente non categorizzati come “lavoro ripetitivo”. In un certo senso, persino il mio lavoro come computer scientist potrebbe già venire considerato in una categoria a rischio.

Leggi anche: L’Intelligenza Artificiale generativa e il futuro del lavoro

In altre parole, il progresso tecnologico potrebbe continuare a creare nuovi tipi di lavoro, ma non è necessariamente vero che gli esseri umani saranno i più adatti ad eseguirli: al contrario, c’è una certa probabilità che le macchine forniscano sempre più frequentemente un’alternativa più economica, anche per i molti nuovi compiti imprevedibili che emergeranno dal progresso tecnologico stesso. Allo stesso tempo, la velocità esponenziale con cui le nuove tecnologie stanno rendendo obsolete le vecchie professioni aggiungerà “attrito” al sistema, rendendo sempre più difficile per le persone adattarsi, imparare nuove competenze e riposizionarsi, minando alla base uno degli strumenti principali che il mercato del lavoro ha sempre avuto per assorbire la disoccupazione tecnologica. Se questa analisi è corretta, nei prossimi decenni il progresso tecnologico potrebbe porci di fronte a forme di disoccupazione di massa mai viste prima, sia di natura frizionale che strutturale.

La forma e il controllo del futuro

Ma indipendentemente dal futuro del lavoro, quello su cui è necessario porre estrema attenzione è che i quattro nuovi tipi di automazione sopra elencati possono essere considerati i principali motori della crescita ulteriore dell’economia delle grandi piattaforme digitali di oggi. E un eventuale arrivo del metaverso – visto non come un prodotto specifico, ma come una versione più immersiva, più intangibile e più invasiva di Internet – potrebbe renderne gli effetti ancora più evidenti. Prevedere come questi nuovi strumenti, combinati con gli imperativi di crescita ed espansione del mercato, influenzeranno in modo più ampio la tecnologia e avranno un impatto sulla società in assenza di una regolamentazione specifica non è necessariamente più facile dell’obiettivo generale di predire il futuro. Ma per gettare uno sguardo su di esso, possiamo trovare alcuni strumenti preziosi nelle potenti analisi fornite da una donna di incredibile statura.

Susan Strange è stata accreditata come “responsabile quasi esclusiva per la creazione [del campo] dell’economia politica internazionale”. Nel suo magistrale lavoro Stati e Mercati, Strange ha indagato quelle che ha identificato come le quattro principali forme di potere relazionale e strutturale: controllo su sicurezza, produzione, finanza e conoscenza. Per rappresentarle, ha suggerito di vedere questi quattro tipi di potere come le quattro facce di un tetraedro, dove ogni faccia tocca le altre. Se uno stato ha il controllo della sicurezza tramite una forza militare potente, può utilizzare il suo potere per controllare le aziende che operano all’interno dei suoi confini, i sistemi finanziari che interagiscono con esso e la distribuzione di conoscenza e istruzione tra i suoi cittadini. Allo stesso modo, un forte potere finanziario può portare il mercato a controllare i sistemi di produzione e l’accesso individuale sia alla sicurezza fisica che legale, nonché a forme preferenziali di istruzione.

Nelle parole stesse di Strange, il potere conferisce la capacità di “fornire protezione, creare cose, ottenere accesso al credito e sviluppare e controllare modalità autorevoli di interpretare il mondo”. In modo quasi profetico, nel 1988, discutendo dei potenziali cambiamenti che la rivoluzione dell’informazione avrebbe probabilmente apportato, Strange aveva riconosciuto che “potere e autorità vengono conferiti […] a coloro che sono riconosciuti dalla società come possessori della conoscenza ʻgiustaʼ e desiderabile e impegnati nell’acquisizione di sempre maggior conoscenza, a coloro a cui è affidato il suo archivio, e a coloro che controllano in qualsiasi modo i canali attraverso i quali la conoscenza o l’informazione viene comunicata”.

Nel contesto attuale, queste ultime parole dovrebbero suonare cautamente familiari: poiché il controllo sulle informazioni pubbliche e private nelle mani delle grandi piattaforme continua ad aumentare, queste stanno inevitabilmente estendendo il loro potere anche sui beni e servizi di cui abbiamo bisogno o siamo costretti a utilizzare, e sul nostro accesso alle informazioni e alla conoscenza stessa. Inoltre, poiché le economie digitali che hanno creato continuano a plasmare in modo sempre più profondo il mercato del lavoro, e poiché le loro tendenze monopolistiche continuano a concentrare sempre più denaro nelle mani di una frazione sempre più piccola della società, le piattaforme stanno anche espandendo il loro controllo sul credito. Negli ultimi anni alcune piattaforme hanno infatti persino cercato di creare le proprie valute digitali. Infine, poiché la spinta verso costi sempre più bassi sta spingendo i governi a esaminare l’automazione di molte decisioni legali e a sostituire persino parte del sistema giuridico e delle forze dell’ordine e dei sistemi di difesa con intelligenze artificiali, rischiamo di mettere in gioco persino la nostra sicurezza fisica.

Leggi anche: Fra etica e algoritmi

Questo nuovo sbilanciamento nella distribuzione del potere è facilmente individuabile nella grande concentrazione di capitali in un settore ristretto del mercato del lavoro. Come mostra chiaramente il rapporto dello Stanford AI Index, i nuovi lavoratori qualificati dell’economia delle piattaforme digitali sono gli informatici e i data scientists, che ricevono salari sempre più alti per controllare i metodi sempre più sofisticati di intelligenza artificiale e apprendimento automatico. Specialisti informatici come me che hanno lavorato al cuore di aziende come NVIDIA occupano una nicchia ancora più piccola. In larga misura, questa concentrazione di ricchezza è una manifestazione di una concentrazione nella conoscenza e del potere sulla conoscenza.

L’oligopolio dei dati

In un mondo in cui l’intelligenza artificiale sta facendo progressi sorprendenti ogni giorno, e in cui rischia di rendere obsoleto un gran numero di professioni, coloro che capiscono come funziona e possono controllarla per i propri scopi otterranno inevitabilmente un vantaggio economico. Ma un punto ancora più sottile da sottolineare è che, poiché l’IA e l’apprendimento automatico consentono di elaborare e dare un senso a quantità enormi di informazioni che nessun essere umano potrebbe nemmeno visionare, il controllo sulla conoscenza si sta amplificando esponenzialmente verso livelli che non hanno precedenti.

Allo stesso tempo, solo poche aziende, che hanno beneficiato precocemente dei cosiddetti ‘network effects’[3] e della scalabilità delle reti di computer, dispongono degli immensi quantitativi di dati, delle immense risorse computazionali e degli immensi capitali di ricerca e sviluppo attualmente necessari per costruire la prossima generazione di modelli fondazionali.[4] In un mercato neoliberale, non è difficile immaginare come queste dinamiche auto-rinforzanti possano rapidamente portare a una singolarità nella distribuzione del potere strutturale. Le promesse e la ricerca di obiettivi puramente economici possono facilmente renderci ciechi di fronte a cambiamenti che sono potenzialmente pericolosi per la democrazia stessa.

In questo contesto, l’analisi delle forze e degli interessi in gioco e l’economia politica possono aiutarci a comprendere come, in assenza di un adeguato sistema di norme e regolamentazioni, la proliferazione di IA sempre più pervasive e l’avvento del metaverso potrebbero facilmente diventare uno strumento di potere ancora più potente nelle mani di entità private e governi. Se vogliamo contrastare alcune di queste tendenze potenzialmente critiche, rendendo il web e il metaverso un luogo più equo e garantendo che le intelligenze artificiali e i centri finanziari di potere che esse rappresentano non acquisiscano un controllo eccessivo sul nostro futuro, dovremo assicurarci che i nostri rappresentanti e legislatori eletti all’interno dei governi e delle istituzioni addette alla regolamentazione perseguano queste cause a nostro nome, ponendo limiti molto più stringenti all’insaziabile desiderio di crescita del mercato.

Senza adeguate misure volte a ridistribuire i guadagni, e a limitare la socializzazione dei rischi, i nuovi livelli di automazione resi possibili dalle sempre più potenti IA controllate dal settore privato rischiano ancora una volta di giocare principalmente a vantaggio di una cerchia sempre più ristretta della popolazione mondiale, avvicinandoci pericolosamente a quello che potrebbe davvero essere un futuro distopico – non tanto per via di lontani rischi esistenziali, quanto per rischi concreti, e già tangibili.

NOTE

[1] Henry Kissinger, Eric Schmidt, Daniel Huttenlocher, The Age of A.I And Our Human Future, Hodder and Stoughton Ltd, 2021, pp. 169-170 (tradotto e pubblicato in italia da Mondadori: L’era dell’intelligenza artificiale. Il futuro dell’umanità, 2023).

[2] Alcune compagnie emergenti stanno già promuovendo l’utilizzo di tali avatar nel mondo educational, portando come argomenti a favore di un simile sviluppo l’omogeneizzazione della qualità dell’insegnamento e il taglio dei costi relativi.

[3] Il circolo ‘virtuoso’ in cui più utenti possiede una piattaforma, più incrementa il suo valore, e più tende dunque ad acquisire nuovi utenti, a velocità a volte sorprendenti, come nel caso di Whatsapp e TikTok che sono giunte ad avere un miliardo di iscritti in pochi anni.

[4] Basti pensare al fatto che Amazon, il più grande cloud provider al mondo, nel 2022 ha potuto investire 73,2 miliardi di dollari in ricerca sviluppo, quando in un paese come l’Italia nel 2020 gli investimenti per la ricerca dell’intero settore pubblico e privato hanno sfiorato solo i 28 miliardi di dollari; al fatto che NVIDIA, maggior produttore di soluzioni hardware e software per l’IA, ha recentemente superato la soglia del trilione di dollari di valutazione sul mercato; o al fatto che OpenAI, la società che ha prodotto ChatGPT, ha già ricevuto oltre 10 miliardi di dollari da Microsoft da investire esclusivamente nella creazione di questi modelli.